ニュース

PFN、ドローンやロボット向け視覚言語モデル「PLaMo-VL」 フィジカルAI活用へ

2026年4月3日 14:29

Preferred Networks(PFN)は、ドローン、ロボット、監視カメラ、自動車などの自律稼働デバイス向け視覚言語モデル「PLaMo-VL」を開発し、8Bモデル「PLaMo 2.1-8B-VL」と小型の2Bモデル「PLaMo 2.1-2B-VL」を公開した。

近年、物理世界の状況を理解して判断・行動するフィジカルAIの活用が広がる一方、従来のクラウド型AIには大量のセンサーデータ送信による通信負荷やリアルタイム性の低下、機密情報のセキュリティリスクといった課題があった。

また、フィジカルAIの産業応用では、AIが単に画像を認識するだけでなく、「何が起きているか」を判断し、その根拠を人に説明できることが求められる。

PLaMo-VLは、こうした課題に対応するため、エッジデバイスの限られた計算資源でも高精度に動作することを目指して開発された。また、画像に基づいて状況を言語で理解・判断する「VQA(Visual Question Answering)」と、その判断が画像中のどの対象に基づくのかを位置情報として示す「Visual Grounding」の性能を強化している。

これにより、「どこで何が起きているか」を明確に把握し、ロボットによる作業支援や設備点検、物流管理、交通監視など、安全性や運用信頼性が求められる現場での活用を見込む。

両モデルは、「PLaMo 2.1-8B」と「PLaMo 2.1-2B」をもとに画像理解能力を統合したマルチモーダル基盤モデルで、エッジデバイス上での動作を想定して設計された。PLaMo 2.1-8B-VLは、日本語VQAとVisual Groundingのベンチマークで同規模の既存オープンモデルを上回る性能を達成したとしている。

GENIAC第3期では、同モデルを用いて工場での作業タスク分類や、発電プラント設備の異常検出にも取り組んだ。作業タスク分類では、作業者の姿勢や周辺環境だけでなく、使用中の工具にも着目。Visual Groundingで工具の位置と種類を特定し、VQAによって作業内容を推定することで、判別が難しい複雑な作業工程も高精度に理解できたという。

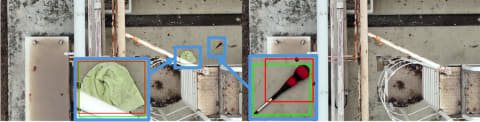

ドローン画像からの異常検出では、正常時と現在の画像を比較し、位置・画角のずれや照明変化による見かけの差分ではなく、異常に結びつく意味のある変化を抽出した。また、異常の位置を示すバウンディングボックスと、その種類を示すラベルを生成し、現場での確認や対応に活用できる形で提示した。

いずれの実験でも、PLaMo 2.1-8B-VLは「Qwen3-VL-235B-A22B-Instruct」などのオープンモデルを上回るベンチマーク評価を得たといい、既知工程に対する作業漏れや手順逸脱の検出、設備点検や監視業務における見落としの低減などへの活用が期待できるとする。

PFNは、これらの成果によりGENIACモデル賞を受賞した。今後、産業現場の特定用途を対象にした実証実験や、現場データの追加学習を進め、実運用環境で得たフィードバックをモデル開発に反映する。