西田宗千佳のイマトミライ

第335回

言語の壁が低くなった Xとスマートグラスの「翻訳」はなにをもたらすか

2026年4月6日 08:20

AIの普及により、言葉の壁は急速に低くなってきている。

先週、注目すべき動きが2つあった。

1つは、スマートグラスのトップシェアであるMetaが、日本市場にも数カ月以内に「Ray-Ban Meta」をはじめとした製品を投入する、と正式にコメントしたことだ。これらにはライブ翻訳機能があり、異なる言語同士の会話に役立つ可能性がある。

そして2つめは、ソーシャルメディアのXで、自動翻訳機能が自動適用されるようになったこと。この結果、他国向けに書かれたポストが日本語のものと同じように流れてくるようになってきた。

今回は、こうした「AIによるカジュアルな翻訳」が、我々の生活にどう影響を与えるのかを考えてみよう。

Ray-Ban Meta、2年半遅れでついに日本上陸へ

まずはスマートグラスの話から始めよう。

冒頭で述べたように、Metaはついに、同社のスマートグラスを日本などに展開すると明言した。新機種の発売に合わせてのものだ。

これまでも噂は何度もあったのだが、正式なアナウンスの中で日本市場のことが言及されたのは、筆者が知る限り初めてのことである。

現状は「数カ月後に」とだけ言及されており、正式な発売日などはコメントされていない。その点に留意は必要だ。

MetaのスマートグラスといえばRay-Ban Meta、という感じなのだが、ラインナップが広くなっているので少し整理をしておきたい。

Metaがサングラス型のデバイスを最初に発売したのは2021年のこと。カメラを搭載し、自分の視界をシェアできるデバイスとして登場している。当時の名称は「Ray-Ban Stories」。その後2023年に「Ray-Ban Meta」として発売が開始されている。名称がRay-Ban Metaになってから製品性が上がり、ヒットにつながった。

カメラ・マイク・スピーカーを内蔵しており、ディスプレイはない。スマホと連動して、スマホ内での処理を活かして利用できる。アメリカで実機を試した記事も掲載しているので、詳細は以下の記事をご覧いただきたい。

その後Metaは、Ray-BanだけでなくOakley(オークリー)と組んだ製品も発売、今回はサングラスでなく、いわゆる「度付きメガネ」として発売される。今回の新製品はこれである。

昨年アメリカでは、ディスプレイを内蔵した「Ray-Ban Meta Display」も発売している。こちらはカメラ・マイク・スピーカーだけを搭載したものとは異なるラインナップで、日本発売のアナウンスはない。

スマートグラスはAIで注目 実用性では「翻訳」に着目

これらの製品が注目されるのは、MetaのAI戦略の中に組み込まれているからだ。

カメラやマイクからの入力をスマホとクラウドのAIで処理すれば、より大きな価値が生まれる。カメラで見えているものが何なのかをAIが答えたり、見ているものを覚えておいて後から「あれは何だったのか」を答えたりと、人間をサポートするデバイスとして活用できる。

この可能性はかなり大きなものだ。だから、多くの企業が「スマホと連携するスマートグラス」を開発している。

GoogleもAndroidを使ったプラットフォームである「Android XR」でRay-Ban Metaスタイルのスマートグラスを開発中だし、中国系のRokidやEven Realitiesなど、多数の企業がすでに製品を発売している。より多くの企業、より大きなプラットフォーマーが参入の準備をしている……という噂も多い。

正直なところ、画像認識とAIの関係は、まだそこまで便利とは思えない。Ray-Ban Metaを買った人も、AIのために使うというよりは「カメラで撮影する」ことが目的だろう。自分の主観視点でカメラが使えるのは、確かに面白いものだ。

一方、カメラとして使うにしろセンサーとして使うにしろ、「カメラがある」ことは社会的な摩擦を生むことも多い。プライバシー侵害だと考える人も多いのだ。もちろん、「撮影中はLEDを光らせる。機能的にオフにできない」といった配慮はあるのだが、問題は周囲との関係性にある。「そういうものだ」と認識が定着すればいいが、アメリカでも課題になってきている。日本での落としどころはさらに難しい。

確実に大きなメリットとなるのは「ライブ翻訳」機能だ。

MetaのAIでも、スマートグラスからの音声を聞き取ってスマホで翻訳し、その内容を自分にだけ聞こえるようにする機能がある。

同様の機能はアップルが昨年から「ライブ翻訳」として搭載しているし、Googleも、「Google翻訳」でライブ翻訳に対応、一気に一般化してきた。

イヤホンでもいいが、スマートグラスの方がつけ続けるのは楽で、向いていると言えそうだ。

いくつかのデバイスで使ってみた個人的な感想として、どのメーカーのものも「完璧な翻訳」にはならない。1対1で順に話していくような形でないとうまくいかないことも多い。

そういう意味で言えば、双方が対話できないもしくは片言レベル同士で、日常的な会話に使う……というのが現状はベストであると思った。すなわち、店で旅行者が使うようなパターンだ。

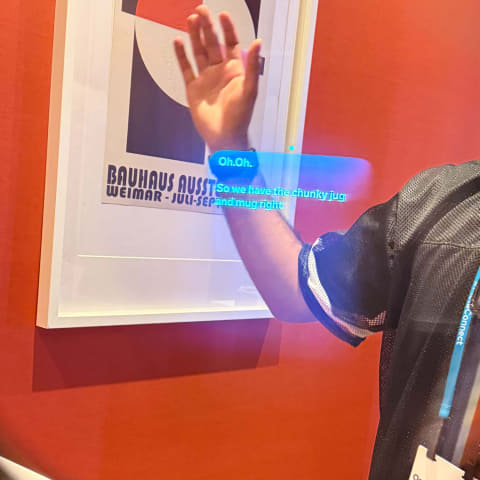

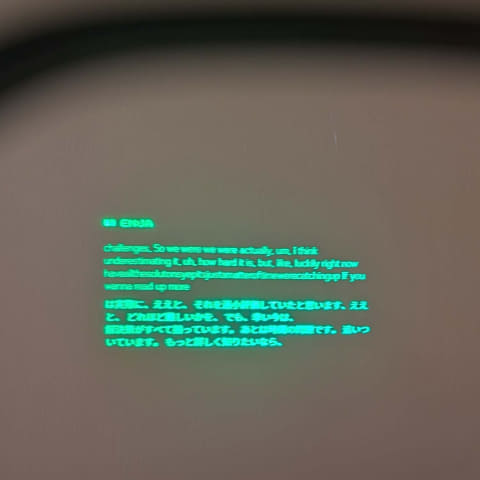

その上でもっと便利だと思ったのは、「ディスプレイ内蔵のデバイスで、相手の話したことを表示する」というパターンだ。

筆者はEven Realitiesの「Even G2」をよく使っている。筆者は一応、通訳なしでも英語でコミュニケーションができる。その状態で、海外取材中に使ってみたが、聞き取った内容が少し遅れて視線の中に日本語で表示されるので、「相手の言葉を確認しながら話す」ような感覚になる。

これは意外なほど便利で、今、翻訳機能を使うなら、「一応英語ができる人が、ある種の補助輪として使う」のがベストであるように思う。

どちらにしろ、スピードの面でも精度の面でも通訳者にはかなわないので、「完璧でないことを理解して使う」技術だと考えればいいだろう。

Xの「自動翻訳」で対話はどう変わるのか

翻訳という意味では、Xの翻訳機能には驚かされた。

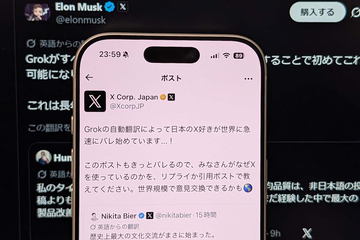

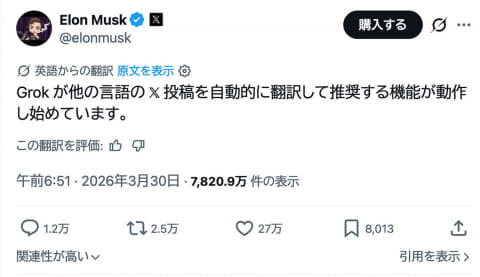

以前よりGrokを使った翻訳はできたのだが、イーロン・マスクは「Grokが他の言語のX投稿を自動翻訳して推奨する機能が動作し始めています」とポストし、この機能が「自動的に働くようになった」ことを明かした。

Grok automatically translating and recommending 𝕏 posts from other languages is starting to work

— Elon Musk (@elonmusk)March 29, 2026

結果として、日本と海外の間で言語を超えたコンテンツの流通が加速された。タイムライン上での流行としては、それが「アメリカンBBQに関する日米の交流」という形に見えたのではないか。実際には他にも多くの話題が言葉を問わず交わされている。

Such great content from Japan! 🇯🇵https://t.co/3QBMcjls17

— Elon Musk (@elonmusk)April 1, 2026

Grokの翻訳機能は、特にXのポストのような書き込みを、かなりうまく扱ってくれる。品質は時に、他の翻訳サービスを超える。

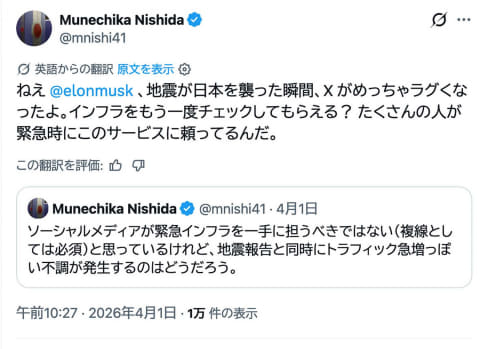

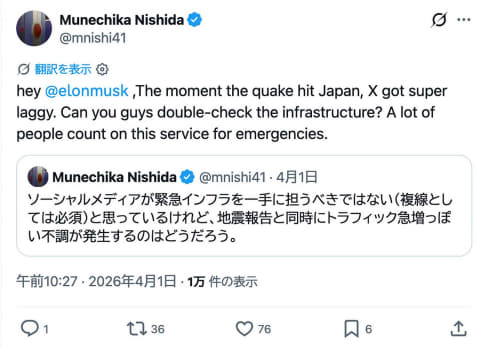

以下は、筆者があえて英語で、できる限りフランクな文体で書いてみたものだ。それが他の人には日本語に見えたようだ。実際日本語翻訳を見ると、かなりニュアンスを反映した形になっているのがわかる。これはすごいことだ。

hey@elonmusk,The moment the quake hit Japan, X got super laggy. Can you guys double-check the infrastructure? A lot of people count on this service for emergencies.https://t.co/2017dg7OWu

— Munechika Nishida (@mnishi41)April 1, 2026

こうした機能の存在をどう考えるべきか?

筆者は「基本的にはプラス」と考えている。

筆者は英語圏を中心に、月に1度は海外出張をしている。そこで感じるのは、「文化には必ず壁がある。だが、言語の壁は低い方がいい」ということだ。その方が楽しいし、疲れない。筆者自身、スマートグラスを含め、複数のテクノロジーに助けられている。

それと同じように、Xの自動翻訳は言語の壁を低くする。これを単純に否定する気にはなれない。

言語の壁は「低くなった」。その功罪とは

他方で、これで言語の壁が「なくなった」わけではない。低くなっただけだ。そういう意味では、ライブ翻訳の位置づけと変わらない、と言える。

特に、「ニュアンスまで含めて翻訳する」要素は、時に危険な状況も生み出す。

Grokは生成AIなので、「次に来る文章としてどういう内容が適切か」という判断に近い挙動をする。そうすると、学習した文脈や単語の偏りが翻訳に影響してくる。ニュアンスを汲み取ってくれるのはそのプラスの面ではあるが、まったく違う言葉に入れ替えてしまう、といったミスはマイナスの面だ。

Grokの翻訳が間違っていても、そのことに気づく人はどのくらいいるだろうか? これは確かに危険なことではある。違和感を持ったら原文に戻って読む、という努力は必要になる。だが、それを全員に強いるのも難しいことだ。

一方で、また別のことも考えている。

ソーシャルメディアの書き込みを読んだ後、多くの人は感情的に反応する。もちろん筆者も例外ではない。そこでは多数の誤読も発生する。母国語ですら誤読するのに、翻訳ならどうだろう?

そもそもソーシャルメディアという存在が「感情のアンプ」であり、冷静な対応とは相性が悪い。

だとすれば、そのことは正しい翻訳以上の問題である。感情に任せて素早く反応し、それを繰り返すことがページビューを増やすことにつながる、という構造が変わるのか、というと、おそらくは変わらない。

そして、Xのアルゴリズムが作るフィルターバブルやエコーチャンバーも、同様に存在する。まったく違う人々と接しているように見えて、実はそうでもないはずだ。そこに翻訳が加わることの長期的な意味は、まだ見えてこない。

だが、美味しく焼けた肉や各国の面白いものがより多く流れ、互いに率直なコミュニケーションが成立している現状を「悪いもの」と考えることも難しい。

言語の壁が「低くなる」ことには必ず価値があると信じている。ただ、その価値が全ての問題を解決する万能薬というわけでもない。

良いコミュニケーションが可視化されることが「感情のぶつかり合いの不毛さ」の認知を高め、そのことをビジネスの種にする人々を減らす助けになれば、と考えている。