ニュース

リコー、企業の暗黙知をAI対応にするマルチモーダル新モデル

2026年3月30日 14:00

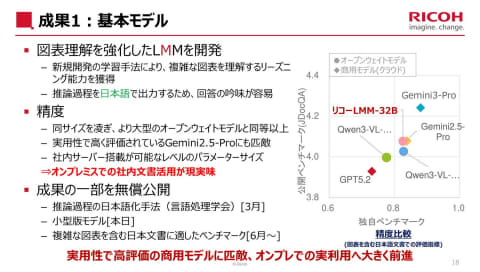

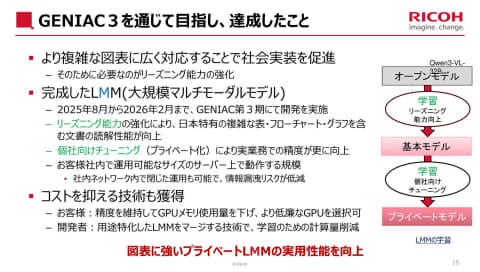

リコーは、図表を含むドキュメントを、高精度に読み取ることができる推論(リーズニング)性能を備えたマルチモーダル大規模言語モデル(リーズニングLMM)の基本モデル「Qwen3-VL-Ricoh-32B-20260227」の開発を完了した。多段推論を通じて複雑なドキュメントを理解できる点が特徴となる。

同モデルは、アリババクラウドによる「Qwein 3.0-VL」をベースとし、経済産業省とNEDOによる国内生成AI開発力強化プロジェクト「GENIAC」第3期で進められていたもの。「Qwen3-VL-Ricoh-8B-20260227」を、30日から無償公開したほか、リーズニング性能の評価に特化したリコー独自開発のベンチマークツールも、今後公開予定としている。

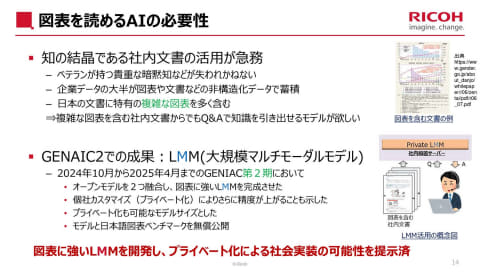

LMM(Large Multimodal Model)とは、テキスト・画像・音声・動画など複数の種類のデータを同時に処理できるAI技術。スクリーンショットからのテキスト要約や、図表を含む質問への回答など、幅広いデータ形式を扱える。

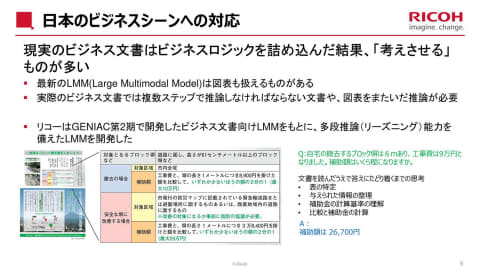

企業内のドキュメントでは、テキストだけでなく、図や表組、画像なども含まれており、「テキスト検索では意図した結果が得られない」、「検索機能のみでは文書の十分な活用が難しい」といった課題があることから、マルチモーダルな処理が求められている。

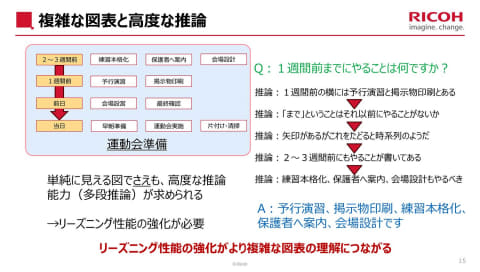

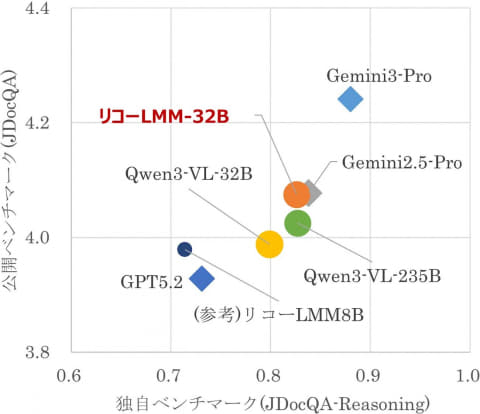

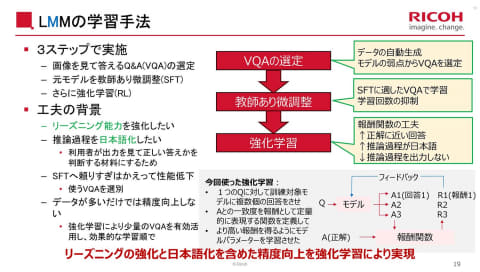

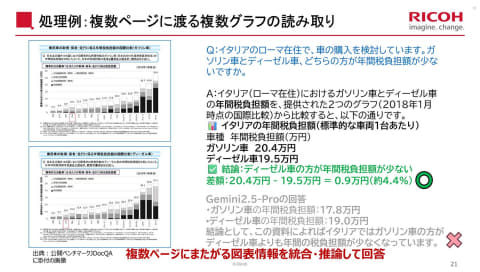

今回、「Qwen3-VL-32B-Instruct」をベースに、多段推論によって複雑なドキュメントを高精度に理解できるリーズニングLMMの基本モデルとして「Qwen3-VL-Ricoh-32B-20260227」を開発。複数ページにまたがる図表を関連付けて理解し、読解難易度の高い質問に対しても、高精度な回答を生成できるようになった。強化学習では、独自の報酬関数を設定することで、学習効率を高める一方、過学習を抑制している。

これらの取り組みにより、「Gemini2.5-Pro」などの大型商用モデルと同等のベンチマーク結果が確認できているという(2026年2月17日時点)。

さらに、日本企業での実務利用を想定し、思考プロセスの日本語化にも取り組んでいる。これにより、日本語文書の読み取り精度向上のほか、回答の判断根拠や前提条件を日本語で確認できるようになり、実務利用における信頼性を高めた。

高い精度をもちながら、パラメーターサイズも減らし、社内サーバーに搭載できるレベルとすることで、オンプレミスでの社内文書活用も可能としている。ファインチューニングに対応するほか、プライベートモデルの提供にも対応する。

暗黙知をAI-Readyに

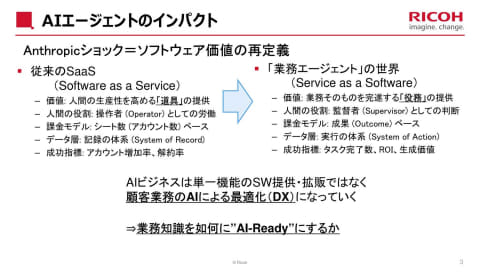

リコーでは、AIによる業務情報の活用に向けたソリューションを強化しているが、企業内には、図表の中の情報など「AI-Ready」ではない情報が大量に存在し、従来のRAGやテキスト検索ではほしい答えにたどり着けないといった課題がある。

こうした“暗黙知”となる情報を、人もAIも読めるデータにしていくことが、課題解決のきっかけになると説明。図表に強いLMMを開発し、プライベート化による企業利用の推進を目指す。

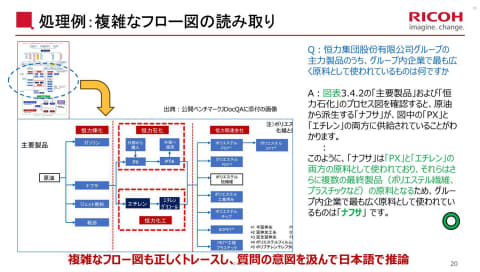

例えば、科学材料の複雑なフロー図について質問して、フロー図を正しくトレースし、質問の意図を汲んで日本語で推論して回答するといった用途や、複数ページにわたる複数グラフの読み取りなどに対応する。

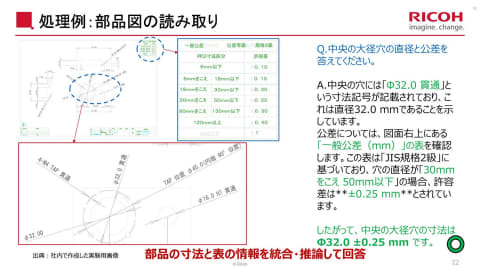

具体的な事例では、部品図を読み取り、部品の寸法と表の情報を統合して、推論して回答する。「中央の大径穴の直径と公差を答えてください」と問いかけると、中央の穴には「Φ32.0貫通」という寸法記号が記載されており、図面右上にある「一般公差(mm)」の表を確認して許容差は±0.25mmとされていることから「中央の大径穴の寸法はΦ32.0 ±0.25mmです」などと回答する。

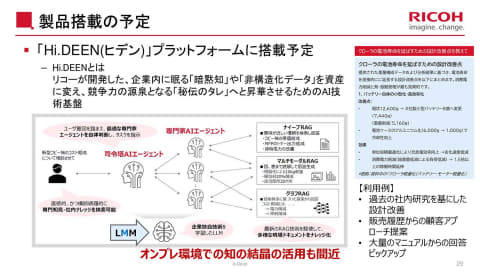

リコーでは新モデルを「オンプレLLMスターターキット」や「Hi.DEEN(ヒデン)」プラットフォームに搭載し、企業向けに展開していく。