西田宗千佳のイマトミライ

第306回

「さらにAI特化」したPixel 10シリーズ 完成度は高いがクセも強い

2025年9月1日 08:20

8月28日、Googleのスマートフォンである「Pixel 10」シリーズが発売になった。読者の中には、すでに手にしている方もいるかもしれない。

筆者もレビュー機材をGoogleから借り、色々なテストをしている。

結論を先に言えば、外見よりも中身が変わったスマホであり、特にAI関連機能の進化が目立つ。

しかし。その「中身自体の評価が非常に難しい」製品でもあるのだ。

それはどういうことなのか? 深く考えていくと、「AI時代のスマホとはなにか」という根本に至る疑問に行き着く。

今回はその点を考えていこう。このことは、この後に出てくるiPhoneなど、多数のスマホに関わる重要な問いでもある。

デザインは「ほぼ」変わらず Qi2の「マグネット」に対応

まず分かりやすいところから行こう。

デザインはPixel 9シリーズからほとんど変わっていない。ただし、変わっていないわけではないので、これまでのケースがつかない場合がある。カメラ周りをよく見ると、ほんの少し位置やフレームの太さが変わっている。ケースを買う時には注意しよう。

Pixel 10 Proシリーズの新色である「Moonstone」と「Jade」の色はいい。デザインが大きく変わってない以上、色で新しさを打ち出すのは当然。この路線は悪くない。

先に示しておくが、価格もPixel 9シリーズと同じになっている。下取りやクーポン、携帯電話事業者経由での分割販売など、できる限り安価にするためのキャンペーンも数多い。それだけGoogleと携帯電話大手4社が期待していて、売りたい製品であるということだ。

個人的にもありがたかったのは、Qi2の「Magnetic Power Profile」に対応したことだ。Pixel 10では「Pixelsnap」と呼んでいる。「MagSafe対応」と書かれることもあるが、正確な表記ではない。とはいえ、「MagSafe互換の機器とくっつく」と考えると分かりやすいので、そう表記するのもわかるのだが。

Magnetic Power Profileは無線充電規格であるQi2において、「磁石の力で容易に充電位置を決められる」利点をもたらすものだ。正確には「磁石でどこかに固定できる」規格ではないので、つけたからといって落ちないというものではない。実際、Pixel 10シリーズの磁力はiPhoneのものより若干弱い印象がある。Pixel 10に限らずだが、過信はしない方がいい。

ただ、充電位置をラフに決められることは確実にプラスだし、本体を支えておくくらいの磁力は十分にある。

Pixel 10 Pro XLの場合、25Wでの無線充電に対応した「Qi2.2」対応である。そのためか、市場には急激に「25W対応」を謳うものが増えてきた。また、今後出てくる「ニーズの多いスマホ」でも、25W対応がありそうな雲行きである。Qi 2.2対応は10 Pro XLのみなので、その点は気をつけてほしい。

通話を中心にAI機能が強化 「アシスタント路線」へ一方前進

外観が大きく変わっていないとすれば、どこが変わったのか?

それは、AI関連機能だ。

特に目立つのは、通話関連の機能だろう。

自分の声で翻訳して相手に伝える「マイボイス通訳」は、リアルタイム通訳を介して電話するもの。Pixel 10からかけるのであれば、相手はどの電話でもいい。

この機能はPixel 10のSoCを使ったオンデバイスAIで実現されているもので、現状はPixel 10が搭載している新SoCである「Tensor G5」を必要とする。

ここで面白いのは、通話の翻訳ラグの考え方だ。日本語から英語、もしくは英語から日本語だと少し時間がかかるのだが、これは日本語では動詞が最後に来るため。英語は主語の次に来ることが多いので、どういう内容かを伝えるには若干時間が必要になる。一方で、英語からスペイン語のように主語の位置が似た言語同士であれば、翻訳ラグはより短くなるという。

これは翻訳のAIモデルが英語を軸としているためで、現状ライブ翻訳は片方が英語である必要がある。今後AIモデルが進化し、より多彩な言語を媒介とできるようになれば、考え方が変わる可能性もある。

翻訳・音声書き起こしをベースとしたAI機能は以前から多い。iOSでは次期バージョンである「iOS 26」で実現される「コールスクリーリング」も、Pixelでは以前から対応済み。プライバシーを維持するためにも、オンデバイスAIが通話内容を把握しつつ、詐欺対策を軸にセキュリティを高める……というのは基本路線と言える。

マイボイス翻訳に加え、現状Pixel 10のみで使えるもう一つの目玉機能が「マジックサジェスト(英語ではMagic Cue)」だ。

この機能は電話中、電話相手に関連する情報を出したり、これから行く場所に合わせて天気などの情報を出す機能。要は、GmailやGoogleカレンダーとスマホの情報をマッチし、今の行動の中で「欲しいであろう情報」を出す、という予測的な機能だ。

もっとも分かりやすいのは、電話相手に関するメールを出す機能だろうか。

本来は、「航空会社にサポートの電話をかけているときに、そこで関連するフライトチケットの情報をメールから呼び出す」といった挙動になるはずだ。

だが、シンプルに電話相手がマッチした時くらいで、それ以外は、テスト中になかなかうまく働かなかった。

メールが出るだけでも大したものではあるのだが、AIが人間のアシスタントとして働くにはもう少し進歩が必要な印象も受ける。もしかすると、英語ではもう少し違うのかもしれない。

どちらにしろこの機能は、PixelユーザーがGoogleのサービスを活用しており、そのこととPixel 10のオンデバイスAIが連動して働く。プラットフォームとして垂直統合型で、多数のデータが集まるからこそできることでもある。

これもまた、スマホとAIの関係を端的に表したもの、と言える。

GoogleのAIサービスとの連動という意味では、NotebookLMとの連動も強化されている。ボイスレコーダーで書き起こしたデータを、「共有」機能からNotebookLMへ登録可能になっている。

ただ、利用者が望んでいるのはこれではなく、「ボイスレコーダーで録音した音声データを直接NotebookLMに登録する」ことではないか。現状それはできない。

また、現状は「書き起こしを共有から登録する」程度の機能も、Pixel 10以外へのアップデートへの搭載については「当面ない。今後についてもコメントできない」状態だという。

「AI重視」だがベンチマークからは見えづらい

こうした新機能は、新しいSoCである「Tensor G5」によるもの、とされている。Googleによれば、Tensor G5はオンデバイスAI関連の能力を司るTPUが、前モデルに比べ最大60%向上しているという。

また、OS側との連動により、Gemini Nanoを構成するオンデバイスAIモデルが20以上利用可能、とされている。

とはいうものの、これがなかなか厄介だ。

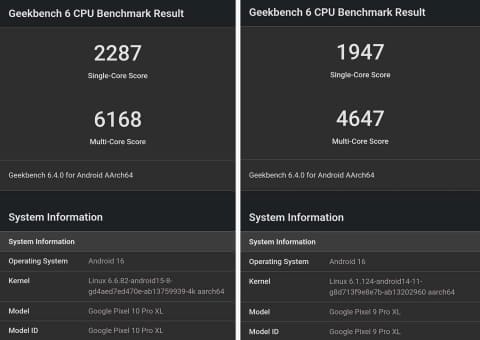

ベンチマークソフトでは、この進化が見えづらい。

Geekbench 6でのテストでは、CPUは順当に速くなっている。一方、GPUは大幅に値が悪い。

Tensor G5ではGPUがArm社のMali系からImagination Technologies社のPowerVR系に変更になっている。一般的な処理では差を感じづらいはずが、ゲームなどでは描画を含めた処理も変わるため、動作検証と最適化が必要だ。ゲームの一部では影響をアナウンスしているものもある。

3DMarkでもテストした。こちらではGPU性能が妥当と思われる形で計測できたが、値はさほど良くなっていない。しかも、Qualcommのハイエンドスマホ用SoCに比べ半分程度の値にとどまっている。

さらに言えば、AI系を謳うベンチマークの結果も、Pixel 9 ProよりもPixel 10 Proの方が悪い値が出る。明らかにおかしい。AIのベンチマークについてはテスト手法もまちまちであり、実際にそのデバイスが使うオンデバイスAIの速度を測れているわけではない可能性もある。こちらは掲載を見合わせる。

そもそも、Pixelで使われているTensor Gシリーズは、QualcommのSnapdragonシリーズに比べ、同じ「ハイエンド」と言われるSoCでもベンチマーク性能では劣る。

だがそこでGoogleは、「オンデバイスAIの処理性能を重視した」とコメントしてきている。実際、搭載されている機能はPixelの方が優れている部分がある。

Tensor G5を搭載したPixel 10シリーズは、さらに「ベンチマークで評価しづらいスマホ」になったのは間違いない。

スマホとして「サービスと機能」を軸にするなら、それは正しい選択だ。

だが、ゲームを主軸にスマホを選ぶならあまり好ましい方向性ではないし、少なくとも、プレイしたいゲームのTensor G5への最適化がどうなるかを見極めるまで、Pixel 10シリーズを選ぶべきではない。

ユニークな「カメラコーチ」 100倍ズームは実用性に疑問

では写真はどうだろうか?

Pixelはカメラ性能や、その上での加工などの優秀さでも評価が高い。

一見したところ、Pixel 10シリーズは「Pixel 9や他のハイエンドスマホと比肩しうるくらいカメラが優秀」だとは感じた。

AI関連の新機能の中でも注目は、撮影を補助してくれる「カメラコーチ」だ。

これは、撮影する対象がなんなのか、AIが判別した上で、「どんなアングルがいいのか」「そのためにはどこまでズームし、どこを中心にすべきか」などを教えてくれる。

この分析自体はクラウド上のAIで行なっているので、撮影時に通信が必須になる。とはいえ、確かに興味深い機能だ。

個人的には、教えてもらうのはちょっと興醒めであり、かかる時間も考えると日常的に使うかは疑問がある。しかし、もう少し速度が速くなり、ちょっとした時にでも使えるようになれば、「写真の撮り方を教わる機能」として有用である、とは感じる。単に撮影するのではなく、AIをアシスタントとして撮影する方向性、として非常に新しい。

もうひとつの注目点が、Pixel 10 Proシリーズで「100倍ズーム」に対応したことだ。

カメラ機能自体は、すでに述べたように「今まで通り良い」。細かくシーンを比べていくと違いは出てくるのだが、シーンを選ばず色々なところで撮りやすい、いいカメラ機能だと感じる。

他方で、特に変わったのが、Pixel 10 Proシリーズでのデジタルズーム機能だ。

Pixel 10 Proシリーズの望遠カメラは光学5倍までのズームに対応している。従来はそこからデジタルズームで30倍までだったが、さらにそこから、生成AIの拡散モデルを使って100倍まで拡大可能になった。

利用する際、最初にAIモデルのダウンロードが行なわれ、そのモデルを使って拡大した画像を「生成」する。

100倍まで拡大して撮れるのは確かに価値もある。以下は拡散モデルによる再構成ありの写真と、同じもので再構成しなかったものの比較である。素材と超解像ズーム Proの特徴がマッチするとここまで印象が変わる。

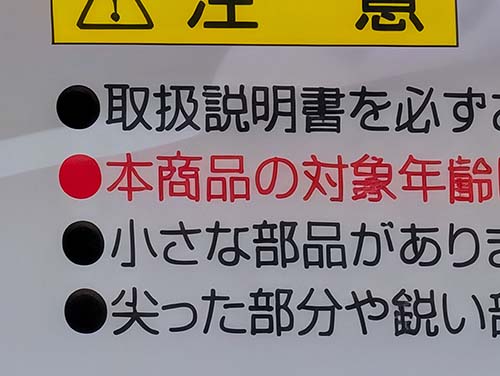

一方で、生成AIの拡散モデルであるがために、元の写真とは違う絵になってしまうことも多い。特に文字関係がわかりやすい。以下の2つはどちらも、Pixel 10 Proを使って文字を100倍までズームして撮影した例だ。スッキリ見えるようになっている一方で、文字の形が崩れているものも見受けられる。

こうしたことから、「これは写真と言えるのか」という議論もあるようだ。

筆者も疑問はあるが、「これはこういう”撮影機能”だ」と考える。

ただし、実用性は高くない。

それは生成するからではなく、「スマホで100倍もズームすると、被写体を狙うのが極めて困難で使いづらい」からだ。Pixelの場合、そこで手ぶれ補正を組み合わせることもできるのだが、それでも狙ったところをちゃんと撮影するのは困難だ。三脚などを組み合わせた方がいいし、手持ちだと相応の慣れが必要になる。

これが20倍から30倍くらいなら、そこまで問題はない。どこまでも数字を追い求めたくなるのもわかるが、実用上疑問があるところまで拡大する機能を載せても、さほど意味はないのではないか。

この点は、SoCでスペックにこだわらない姿勢とははっきり矛盾する。

おそらく、他社が100倍・120倍という数字を謳っているからだろうが、他社だって、そのクラスの機能は正直実用的ではない。Pixelと同様に画像に奇妙な部分が生まれたりもする。筆者が使っているXiaomi 15 Ultraも最大で120倍の望遠に対応するが、かなりAIが絵を作ってしまい、時にはかなり気持ち悪い映像も出てくる。

将来的に、オンデバイスで動かせる拡散モデルの性能が上がれば、100倍ズームでも妙な文字や形を生み出してしまうことはなくなるのかもしれない。それにはまだ時間が必要だろう。そしてそれでもなお、「100倍に拡大した場所を日常的に狙う」のは無理がある。

Googleもそれをわかっているのか、生成した100倍ズーム画像とそうでないものを同時に記録している。前掲の比較画像はその機能によるものだ。

この辺の特性・クセをわかった上で、割り切って使うものだというのが筆者の意見だ。

C2PAでの来歴記録に対応

写真という意味で、より重要なのが「標準でC2PAでの来歴記録に対応した」ことだ。

C2PAとは、画像や写真などのデータに暗号化されたメタデータを付記し、そこに、いつ・どこで・誰がデータを作ったのか、どんなツールで編集したのかなどを記録して「来歴」とする技術だ。業界標準の一つであり、昨年2月、GoogleはC2PAの運営員会に参加している。

カメラがC2PAに対応するということは、「特別なことをしない限り、写真がどんな機械で撮影され、どう編集されたかが記録として残る」ということだ。

Leicaが対応カメラを出しているし、ソニーやニコンは、自社カメラでの報道機関向けにC2PAでの来歴記録機能を提供している。

スマホ向けにも出てくるとされていたが、実際に搭載されているのは、サムスンのGalaxy S25シリーズに続き、Pixel 10シリーズが2例目となる。

C2PAのタグをつけるには相応の処理能力が必要になり、セキュリティチップとの連携も重要だ。Pixel 10シリーズの場合には、Tensor G5とセキュリティチップのTitan M2の組み合わせで実現しているという。

以下はPixel 10 Pro XLで撮影された写真を、Pixel 10のAIツールで加工したもの。元の写真は下のものだ。

これもPixelの「フォト」アプリで確認すると、「AIツールでの編集」と「非AIツールでの編集」という履歴が見える。

また、来歴情報を確認するウェブアプリで見ても、ちゃんと「複数のコンテンツを組み合わせたものです。少なくとも1つはAIツールで作成されました。」と正しく表示される。撮影デバイスが発行したメタデータがGoogleのものであることも明示される。この種のデータがあることで「写真をどのデバイスで撮影し、どう編集したか」がわかるわけだ。

ただし、来歴情報は消すこともできる。そもそも「来歴があるから本物である」「来歴がないから偽物」と判断する技術ではない。「来歴が消されていないから信じる根拠になる」と考えるべきである。

現状はソーシャルメディアなどでの来歴表示は進んでおらず、簡単に判断材料を得られない、という課題がある。こうした部分の進展はこれからだろう。

なお、アドビは来歴記録に積極的であり、業界内でも旗振り役を務めてきた。同社のPhotoshopやLightroomも来歴記録に対応しているが、現状、Pixel 10シリーズで記録した写真を含めた上でアドビの来歴記録機能を使うと、来歴が消えたり、来歴そのものの記録ができなかったりという不具合がある。アドビは「現象を確認済み」とコメントしている。早急な対応を期待したい。

AIを使うなら「今一番良いスマホ」 しかしまだ理想には届かない

Pixel 10シリーズは、非常に完成度の高いスマホである。

スペックなどを気にせず、Googleのサービスと連動し、同社の最新のAI機能を使うなら、圧倒的に価値がある。AIを「実際に生活の中で便利に使う」という意味で、Googleは他社に先行している。特に、通話でのセキュリティや翻訳など、「音声をAIで扱う」部分については優位だ。安心して通話機能を使う、という部分を評価してPixelを選ぶ、という考え方はアリだ。

ただそれでも、スマホの中でAIがアシスタントになる、という機能については、精度やわかりやすさの面で疑問が残る。アシスタントとして機能するには、「利用者が思ったとおり、確実に機能してくれる」ことが必要であり、その結果として「作業を任せられる」ようになる。

Googleはそこへ進もうとしているが、それは今までのスマホの使い方と異なる部分があり、消費者の理解も必要だ。精度とわかりやすさが解消され、「明確に便利なアシスタント」と言えるものになるには、もう少し時間が必要なのだろう。

このリードを他社に対して維持できるかどうか。そして他社がAI以外の新機能で鉱脈を見つけて、追い抜かれる可能性はないのか。

その辺も含めると、色々考察の甲斐がある製品と言える。