ニュース

Waymo、Genie 3で自動運転車が「もしゾウに遭遇したら?」をシミュレート

2026年2月9日 13:24

米Waymoは、Google DeepMindの汎用世界モデル「Genie 3」の研究成果を活用した、自動運転用シミュレーション生成モデル「Waymo World Model」を発表した。

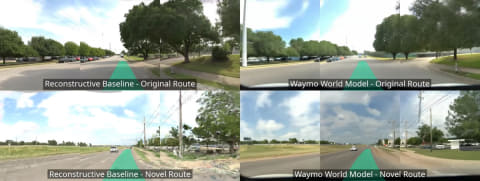

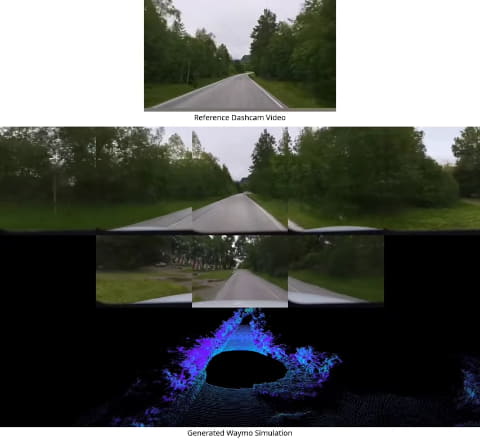

Genie 3を活用することで、フォトリアリスティックな3D環境を生成し、竜巻や象との遭遇など、現実世界ではほぼ不可能な事象もシミュレート。シンプルな言語プロンプトや運転操作などでシミュレーション可能で、カメラとLiDARなど高精度なマルチセンサー向けの出力も生成する。

自動運転業界のシミュレーションモデルのほとんどは、現実世界の路上データから収集したものに基づいて学習されている。今回のアプローチでは、Genie 3が学習している大規模で多様なモデルを使うことで、車両が直接観察したことがない状況をシミュレーション可能になる。極めてレアなケースで起こる事故などへの対応も学習させることで、完全自動運転の安全性を向上させる。

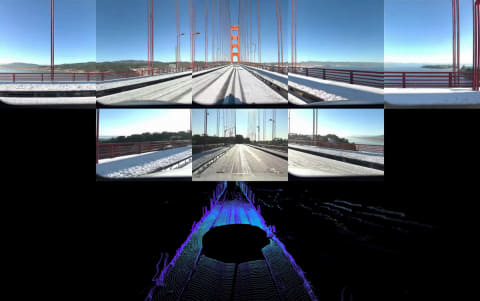

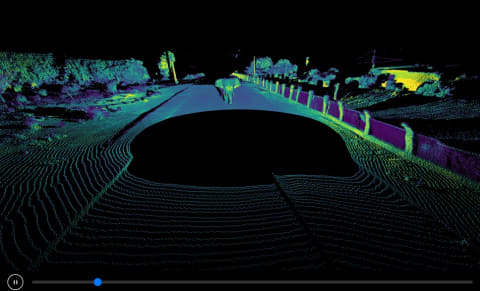

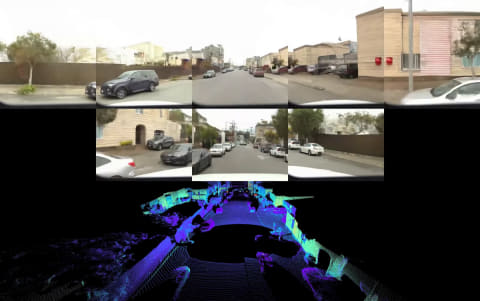

専門的な事後学習を通じ、2Dビデオから得られる膨大な世界知識を、Waymoのハードウェアに固有の3D LiDAR出力へ変換。単なる映像ではなく、LiDARなどのセンサーにも反応できるデータを生成できる。Waymo World Modelでは、日常的な運転シーンから、頻度は低いものの、遭遇すると致命的な状況まで、あらゆるシーンを生成できるとしている。

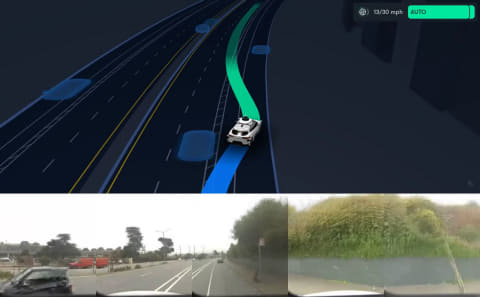

シミュレーションの制御は、運転行動制御、シーンレイアウト制御、言語制御の3つ。運転行動制御では、特定の運転操作に追従する応答性の高いシミュレーターを実現する。これにより「反事実的運転」をシミュレーション可能となり、全く同じシチュエーションでありながら、「もし〇〇だったら」という別の判断・行動を選択した場合の状況を再現できる。こうしたシミュレーション結果を比較・検証することで、運転判断や行動設計の妥当性を評価し、モデル改善に活用する。

シーンレイアウト制御では、道路レイアウト、信号の状態、他の道路利用者の行動をカスタマイズ。さまざまな状況を作り出すことができる。言語制御では、時刻や気象条件などを言語により指定できる。

実際のドライブレコーダーの映像を取り込んで、そこからAIが仮想空間を再現することも可能。LiDAR用のセンシングデータも生成でき、よりリアルな出来事をシミュレーションすることが可能になる。