ニュース

Meta、10代のアカウント保護をより強固に

2025年7月24日 13:29

Metaは、10代の利用者の安全を守る新機能を追加した。

Instagramなどのダイレクトメッセージでは、10代のユーザーがやりとりする相手の情報(アカウント作成日や安全情報)をメッセージの上部に表示。詐欺や不正ユーザーを見分けやすくした。ブロックと報告ボタンも一つにまとめられ、対処がしやすくなっている。

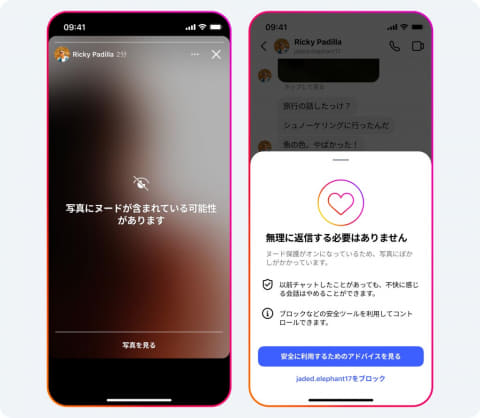

また、ダイレクトメッセージで受信した画像のうち、ヌード画像と思われるものは自動的にぼかしを入れる機能を実装。99%のユーザーが有効にしており、6月には40%以上の受信画像がぼかしのまま保持されるなど、望まないヌード画像による被害を抑制しているという。疑わしい画像を送信しようとした場合にも警告が表示されるため、5月には45%の人がシェアするのをやめている。

自分の子どもの写真や動画を定期的に投稿する保護者や、タレント活動をしている子どものマネージャーなど、13歳未満の子どもを代表して大人が管理しているアカウントにも保護機能を一部適用。

Instagramを利用するには13歳以上である必要があるが、その年齢に達しない場合でも大人が代わりにアカウントを運営していることを自己紹介に明記していれば、アプリが利用できる。ただし、13歳未満の子ども自身がアカウントを管理していると分かった場合、アカウントは削除される。

DMの受信制限、攻撃的コメントの自動非表示なども追加。望まないメッセージを受け取る必要がないよう、DMの受信設定を最も厳しいレベルに自動的に適用し、攻撃的なコメントをフィルタリングする非表示ワードの機能も有効にしている。プライバシー設定も見直すように促す。これらの変更は今後数カ月以内に反映される予定。

10代のユーザーにブロックされた大人のユーザーは、10代のユーザーを見つけにくいようにする対策も実施。お互いのアカウントをおすすめとして表示しないようにし、その大人ユーザーが投稿したコメントも非表示になる。