ニュース

OpenAI、米国防総省と機密AI利用について合意 Anthropic決裂直後に

2026年3月1日 19:00

OpenAIは28日、米国国防総省と機密環境における高度なAIシステム展開について合意したと発表した。この合意には、技術を米国内の大規模監視に利用しないなどの安全対策が含まれており、他のAI企業にも同様の許可を与えるよう国防総省に要請したという。

- OpenAIの技術を米国内大規模監視に利用しない

- OpenAIの技術を自律兵器システムの制御に利用しない

- OpenAIの技術をハイリスクな自動意思決定(社会信用システムなど)に利用しない

【主な安全対策】

また、安全対策スタックに関する完全な裁量権をOpenAIが保持し、クラウド経由で展開し、OpenAI担当者が常時関与するなど、強力な契約上の保護措置を設けているという。

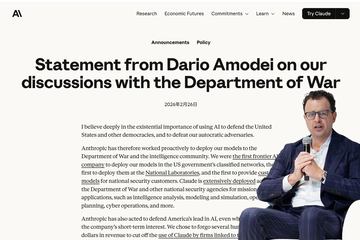

Anthropicと国防総省の係争

国防総省におけるAIの軍における活用拡大については、Anthropicと国防総省との間で問題となっていた。AnthropicのClaudeは、情報分析、作戦計画、サイバー作戦などに活用されているが、安全対策(セーフガード)の撤廃を求める国防総省に対し、「国内における大規模監視」「完全自律型兵器」などの懸念を理由に、Anthropicは撤廃できないと反論していた。

26日にAnthropicが応じないと発表した直後に、ドナルド・トランプ米国大統領は、SNS「Truth Social」で、「過激な左翼のウーク(WOKE)企業」とAnthropicを批判した上で、アメリカ国民の命を危険に晒し、我が軍を危険に陥れ、国家安全保障を脅かしている。政府の全連邦機関に対し、Anthropicの利用を中止するよう指示する」と投稿した。

国防総省のピート・ヘグセス長官は、「効果的利他主義(effective altruism:EA)」という偽善的なレトリックに身を包み、彼らは米国軍を屈服させようと圧力をかけた。シリコンバレーのイデオロギーをアメリカ人の命の上に置く、臆病な企業の行為」と批判し、「Anthropicの米国軍と連邦政府との関係は永久に変更された。利用停止とともに、Anthropicを国家安全保障に対するサプライチェーンリスクとして指定するよう指示する。米国軍と取引する契約者、サプライヤー、パートナーもAnthropicとのあらゆる商業活動を行なってはいけない。Anthropicはシームレスな移行のため、最大6カ月以内の期間に限りサービスを提供し続ける」とXに投稿している。

This week, Anthropic delivered a master class in arrogance and betrayal as well as a textbook case of how not to do business with the United States Government or the Pentagon.

— Secretary of War Pete Hegseth (@SecWar)February 27, 2026

Our position has never wavered and will never waver: the Department of War must have full, unrestricted…

サプライチェーンリスクへの指定は、外国資本による所有や支配が安全保障上の懸念があると判断された場合に、特定の企業を契約から制限・排除できる仕組み。中国企業などを前提としたもので、米国企業のAnthropicを指定するのは例外的な措置となる。

Anthropicは、こうした対応をうけて、彼らが求めるものは「国内における大規模監視」「完全自律型兵器」への利用の禁止と強調。サプライチェーンリスク指定は、「法的に不適切であるだけでなく、政府と交渉するあらゆる米国企業にとって危険な前例となる」と反論し、「国内での大規模監視や完全自律型兵器に関する当社の立場を変えることはない。サプライチェーンリスクの指定については、法廷で争う」との声明を発表している。

また、Anthropicの導入企業については、サプライチェーンリスクの指定は、国防総省との契約の一部としてClaudeを使用する場合にのみ適用されると説明。個人やAnthropicと商業契約を結んでいるケースでは、API、claude.aiなどを通じてClaudeを利用する場合には影響することはないとしている。

より安全な契約とOpenAI サプライチェーンリスク指定すべきではない

こうしたAnthropicと国防総省との係争を経て、OpenAIが新たな契約を結んだ形だが、OpenAIによれば、今回の合意はAnthropicを含む過去の機密AI導入契約よりも多くの安全対策を盛り込んでいるという。

国内大規模監視に利用しないなど、3つのレッドライン(越えてはならない一線)については、安全対策スタックに関する完全な裁量権をOpenAIが保持し、クラウド経由で展開し、機密保持義務を負ったOpenAI担当者が監視ループに参加するなど契約上の保護措置を設けているという。

- OpenAIの技術を米国内大規模監視に利用しない

- OpenAIの技術を自律兵器システムの制御に利用しない

- OpenAIの技術をハイリスクな自動意思決定(社会信用システムなど)に利用しない

Anthropicが拒否した「国内大規模監視」と「自律型兵器」についても、こうしたアプローチにより、政府との対立を回避している。また、OpenAIの契約は「Anthropicを含む過去の合意よりも優れた保証と責任ある安全対策を盛り込んでいる」とし、今回のレッドラインは、クラウド限定(エッジデバイス非対応)で展開すること、安全対策スタックが最適と判断する形で機能し続けること、OpenAI要員が常に監視下に置かれることなどで、確実に履行可能としている。

また、Anthropic契約に至らなかった理由は不明としながらも、同社や他研究所にも検討を望むとしており、Anthropicをサプライチェーンリスクに指定すべきではないと政府に伝えているという。