西田宗千佳のイマトミライ

第340回

Switch 2値上げからMac mini不足まで 「AIエージェント」シフトと演算爆発

2026年5月11日 08:20

現在の社会変化の中で、AI投資が大きな力を持っていることは疑いようのない事実だ。

株式市場を押し上げ、AIサービスの機能が強化されていくだけでなく、我々が買いたいと思う製品にも影響を及ぼしている。

昨年後半から続く、いわゆる「メモリー不足」「フラッシュメモリー不足」は、AI投資の過熱が背景にある。

先週はこの件に関し、複数の動きがあった。部材価格高騰などの理由から「Nintendo Switch 2」をはじめとした任天堂製品の価格が上がった。Switch 2については1万円ほどの値上げになる。

また、Macでは選択できるメモリー量のバリエーションが急に減った。過去には最大512GBのメモリーを搭載できた「Mac Studio」も、現在は最大96GBまでに制限。「Mac mini」についても、64GBや32GBが選択不可になっている。

メモリー不足とは結局どのような状態なのか? 今回はメモリーの生産の話ではなく、「今のAIトレンド」から見ていこう。

ゲーム機を苦しめるメモリー高騰

現在のIT機器におけるメモリー不足は深刻だ。

正確に言えば、今語られるメモリー不足とは「メモリーの調達価格高騰による部材の不足」なのだが、長いので本稿内では「メモリー不足」としておく。

調達価格が上昇しているのは、一般的な機器で使うメモリーチップの生産量が減少しており、その結果として確保の競争が起きているからだ。

AIデータセンター向けの機器で使う莫大かつ高価なメモリーチップには、いくらあっても足りないくらいのニーズがある。メモリーメーカーとしては、生産をAIデータセンター向けに割り当てた方が利益は上がる。

結果として一般製品向けのメモリー供給量が減り、製品各社の調達コストが上がっているわけだ。

ここまで、各社は企業努力でカバーしてきた部分がある。特に、大量に販売される製品では「価格アップ」は売り上げにも響く。しかし、もはやそれが耐えられないフェーズであるのは間違いないだろう。

冒頭でも述べたように、任天堂は自社製品の価格を上げた。日本向けのモデルである「Nintendo Switch 2日本語・国内専用」は、49,980円から59,980円に改定されている。この製品だけでなく、Nintendo Switchも1万円近く値上げされており、部材コスト増が効いているのは明白だ。

特に、日本国内では戦略的に海外モデルに比べ価格を抑えていたため、経営上の負担も大きい。ここでの値上げはまさに「耐えかねた」結果であり、必要なものだったと予想される。

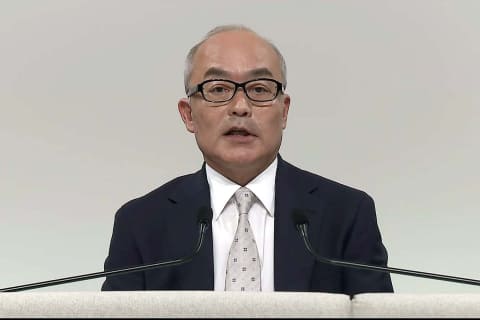

5月8日にはソニーグループが経営方針と2025年度決算説明会を開催したが、その中でも、PlayStation 5の価格について、メモリー不足の影響が語られた。

同社・取締役代表執行役社長CEOの十時裕樹氏は、メモリー不足による価格転嫁がゲーム機の普及に悪影響を及ぼす懸念があることを認めた。

PS5は4月に値上げをしており、「値上げしたばかりなので、PS5のさらなる値上げの予定はない」と説明しつつ、メモリー高騰の対策について以下のように説明している。

「2026年については必要なメモリー数量をほぼ確保。価格についてもサプライヤーとある程度合意しており、コスト増は織り込み済み。今後の変化に対しては、本体価格を上げるのではなく、プロモーションにかけるコストなどでバランスを取りながら収益性をマネージしていく」

また、「業界内の予測として、メモリーの需要逼迫は2027年まで続くと予想されている」とも話す。

ソニーは数年以内に、PS5に続く「次世代プラットフォーム」の提供を控えている。2026年度から次世代プラットフォームに向けた投資の増加を見込んでいる。メモリー高騰は次世代プラットフォームに対しての影響も想定される。

次世代プラットフォームについては「価格や発売時期などは確定していない」(十時CEO)とはいうものの、「ハードウェア全体でのコスト削減や販売方法の工夫、ビジネスモデルを含めたシミュレーションを進めている」と、方針を語った。

AnthropicとSpaceX提携の背景にある「推論ニーズ爆発」の理由

AI投資がメモリー高騰を生み出しているのは間違いない。

一方で、ではAIサービスを提供する大手にとっても需要を満たせているか、というと「そうではない」のが実情だ。

5月6日、AnthropicはSpaceXと提携。SpaceXが所有する巨大AIデータセンターである「Colossus 1」の演算力を全て借り受けることを発表した。

この提携の理由については、イーロン・マスクがOpenAIと険悪な仲であって「敵の敵は味方」であるとか、複数世代のGPUで構成されるColossus 1がSpaceXの今のAI学習ニーズに合わずに余剰となっていたのでちょうど良かったのではないか……といった複数の憶測がある。

ただ、理由はそこまで重要ではない。

明確なのは、最近演算力不足が指摘されていたAnthropicが、NVIDIAのGPUを22万基分、電力にして300MW分の「推論に使える演算資産」を手に入れ、目の前の課題を解決できた……という点だ。

リリースの中でAnthropicは、Claude Codeなどの「利用リミット」を拡大したことを発表している。Claude Codeにかけられていた、「5時間ごとにどれだけAIとやりとりできるのか」という制限が2倍に増えたほか、利用者が増えるピークタイムに制限が厳しくなるという仕組みも撤廃されている。

Anthropicは、昨年に「Claude Code」を開始して以降、利用者が急増している。AIとともにソフト開発をすることは一般的なものになり、ソフトウェアエンジニアの働き方も変わりつつある。エンジニアではない筆者ですら、仕事で必要なアプリを自作して使うようになったほどだ。

AIでソフトを作るための作業は、実はかなり演算負荷が高い。なぜなら、AIとの対話を長く続けるものだからだ。

命令一回あたりの演算量で言えば、動画生成などの方がはるかに多い。だが、機能追加や不具合修正のために対話を繰り返すと、何十・何百という回数の推論を積み重ねることになる。中には、画像を見せて修正案を考えてもらうこともあるだろう。単純な文字のやりとりだけでは済まない。

AIによるソフト開発は非常に便利なもので、巨大なニーズがある。Anthropicはその波に乗り、他社に先んじてきた部分がある。

だが、それだけに演算量ニーズの拡大は急速に起きて、同社のインフラ投資の想定を超えていった。

メモリーが足りなくなり、高騰するほど投資競争をしてもすぐには追いつけない。だから、SpaceXと連携できたことは非常に大きな意味を持つ。

AIを実用的なものにする「AIエージェント」

同時にこのことは、ソフト開発を行なわない人々にも影響を与える。

AIについて話す時、今はもう単体の「生成」ではなく、「AIエージェント」のことしか話題にならなくなった。

なにかを尋ね、文章や画像を生成してもらうのは便利なことではあるのだが、仕事や生活の中での必要性で言えば、ある程度限定される部分もある。

しかし、AIが「自分の指示に合わせて、ある仕事を代わりに進めてくれる」となれば話は別だ。人間の指示をAIが解釈し、実現のためにはどうすればいいかを考え、必要な作業がなにかを分解し、それぞれの作業を行える「AIエージェント」に処理を依頼し、返ってきた結果をまとめ直し、目的を達成する。

結果として、より幅広い、日常的に存在するあらゆる作業について、AIとともに進めることで効率化・高度化が可能になる。現在は初期段階で、なんでもかんでもできるわけではないが、それでも、工夫によってはかなりのことができる。リサーチをお願いした上でそれをプレゼンテーション資料にまとめる、といった作業はその典型例だ。筆者を含め、AIサービスにコストを払っている人は、そうした変化の可能性を肌で感じているだろう。

AIによるソフト開発もAIエージェントの応用例の一つ、ということができる。

つまり、AIエージェントの課題とは「AIの推論と演算量の爆発」である。一般にAIエージェント処理は、単純な質問に対して十数倍の推論を必要とする、とされている。また、各種ツールの実行やスケジューリングなどの処理も増えるため、CPUの負荷も上がる。

AIのためにGPUが必要、というだけでなく、爆発的に増える推論量を賄う推論専用プロセッサーや、汎用処理を行なうCPUがボトルネックにならない設計など、多様な技術開発と投資が必須になる。

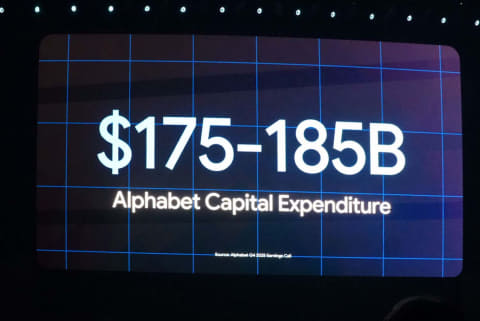

先々週に掲載した本連載で、GoogleがAIに対して、4年前に比べ約6倍もの額となる、1,750億ドルから1,850億ドル(約29兆4,700億円)もの投資を行なうことを説明した。

これも、AIエージェント時代になって爆発的に拡大する演算のニーズをカバーするためのものであり、そのためのプロセッサーやソフトウェア開発を含む。

トップAIプラットフォーマーは競争上、AIエージェントの活用をさらに広げる必要がある。そうすると、演算負荷の問題はさらに深刻なものとなる可能性がある。

AIコスト対策のMac miniが「メモリー高騰」のダブルパンチを受ける皮肉

ここで少し観点を変えよう。

AIエージェントは便利だ。ただ、処理負荷が大きくなるということはそれだけコストがかかるという点でもある。

多くのAIサービスはAIエージェントの要素を持つようになっているが、結果として処理負荷は大きくなる。AIエージェントを使おうとすると、消費者が負担するコストもどんどん大きくなる……というのが現状だ。

AIサービスには一般的に、月額20ドル程度で使える「Pro」プランと、月額200ドルの支払いが必要な「Max」プランが設定されている。

ちょっとした質問や書類の要約や翻訳くらいなら、無料でもできる。その上で本格的に使おうとすると月額20ドルのプランを、というのが去年までの流れだった。

だが、ソフト開発をしたり、AIエージェントの活用をメインにしたりすると、20ドルプランではすぐに限界がやってくる。結果として月額200ドルプランのニーズが増え、そのことがAIサービス事業者の収益改善につながる……という流れになっていた。

確かにその通りなのだろうが、月額200ドル=割引があっても年間1,000ドル(約16万円)以上を支払うのはかなり厳しい。

特にこのことは、パーソナルなAIエージェントで顕著になる。

昨年末から「OpenClaw」というソフトが流行ってきている。

OpenClawはAIエージェントなのだが、PCのファイル操作やウェブブラウズ、予定の管理などを代行し、定期的に行なうことなどを「スキル」として拡張して利便性を高めることができる。

まだまだ技術的ハードルは高いが、自分専用のアシスタントを雇う感覚になり、大きな魅力を備えている。

AIサービス各社は同じような要素を持つ機能を相次いで投入しているし、OpenAIは、OpenClaw開発者のピーター・シュタインベルガー氏を迎え入れてもいる。

OpenClawやそれに類似するパーソナルAIエージェントは便利だが、使えば使うほど推論量は莫大なものになる。外部のAIサービスに推論を依存すると、そのコストだけで月に数万円を超えてしまうようなこともある。

そこでOpenClawでは、「ローカルLLM」を使うことが推奨されている。要は自分のPC/Macの中でLLMを動かし、推論させるわけだ。ハードウェアや電力のコストはかかるが、AIサービスに依存するよりは(年単位で見れば)安価になるし、データなども自分の手元にあるのでプライバシーなどの面でも有利になる。

最近はローカルLLMで使うAIモデルも相当に賢くなってきたので、ソフト開発をローカルLLMで行なうこともできる。そうするとコストメリットはさらに良くなる。

一方、その場合にはメモリーの量が課題になる。一般論として、大きなメモリーの上で動くLLMの方が賢いためだ。

ここで人気となったのが「Mac mini」だ。静かでコンパクト、メインメモリーも先日までは最大64GBまで搭載できた。より大きなメモリーと処理能力が必要な場合、「Mac Studio」を使うことになるが、こちらは価格の問題もあり、ソフト開発者向けのニーズが高い。

現状、ローカルLLMを使うならWindows PCよりMacの方が向いていることなどからMacの方が先にソフト提供が行なわれることも多く、そのことが人気に拍車をかけている部分もありそうだ。

結果として、世界中で「メモリーをそれなりに積んだMac mini」のニーズが劇的に増えることになった。

だが、冒頭から述べてきたように、現在は「AI投資によるメモリー高騰」の最中。AIのニーズをローカルに振り向けるためにMac miniを買おうと思っても、そのMac mini自体で使うメモリーが不足している状況だ。

そのためアップルは、5月6日から、Mac miniとMac Studioで受注するメモリー量のバリエーションを減らした。

M4 Proでは64GBまで搭載可能だったMac miniは最大48GBまでになり、過去には512GBまで搭載可能だったMac Studioも、96GBまでに制限されている。

それでもなお需要は逼迫しており、高性能なプロセッサーと大容量メモリーの組み合わせでは、入手までに数カ月かかる状況になっている。この状況が落ち着くには、やはり数カ月の時間が必要であるようだ。

一方、メモリー不足ではあるが、一般向けのPCやMac、スマートフォンの場合、価格上昇はあっても顕著な品不足とまでは言えない。「AI向けに大容量のメモリーを求める」ニーズが厳しく、生産量に限りがある大容量のメモリーチップがより不足気味である……という状況も見えてくる。

このように、現在のデバイスをめぐる状況は、「AI投資」という巨大な流れの中で、あらゆる方面に対してぐるりと一周するような形で影響を与えあった結果なのだ。