ニュース

グーグル、日本で「検索 Live」開始 音声+カメラでAIモード検索

2026年3月27日 10:01

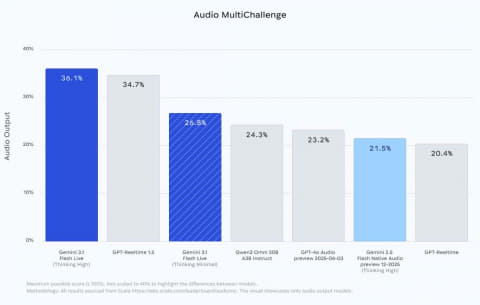

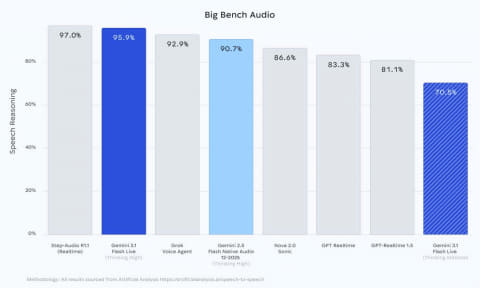

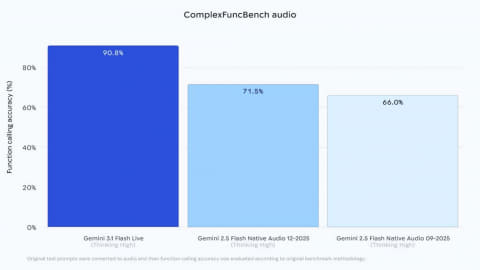

Googleは26日(米国時間)、リアルタイム対話をさらに進化させる「Gemini 3.1 Flash Live」を発表した。これまでで最高品質の音声モデルで、次世代の「ボイスファースト」AIに必要なスピードと自然なリズムを実現するという。このGemini 3.1 Flash Liveを使って、日本でも音声・カメラを使ったGoogle 検索新機能「検索 Live(Search Live)」に対応する。

3.1 Flash Liveは、開発者向けには、Google AI Studio内のGemini Live APIを通じてプレビュー版として提供を開始、企業ではGemini Enterprise for Customer Experience、一般ユーザー向けには、検索LiveとGemini Liveを通じて利用可能としている。

3.1 Flash Liveでは、ボイスファーストエージェントを構築する際の信頼性を向上。また、自然な対話を実現するために、音調の理解も向上し、2.5 Flash Native Audioよりも、ピッチやペースといった音響的なニュアンスの認識を高めている。さらに、ユーザーの苛立ちや困惑の表現に対して、応答を動的に調整する能力も向上したという。

騒がしい環境下でのタスク処理性能も強化。Verizon、LiveKit、The Home Depot などの企業は、自社のワークフローにおける3.1 Flash Liveを高く評価しているという。

一般向けには、Gemini Liveと検索 Liveで提供。日常的な簡単な質問からより複雑な会話まで、より有益で自然な応答を実現可能とした。

3.1 Flash Live モデルによるGemini Live は、従来モデルと比較して応答が高速化されるだけでなく、会話の流れを2倍長く追跡できる。そのため、長時間のブレインストーミング中も思考の流れを途切れさせることなく維持できるという。

検索Live is now global 🌍

— Google (@Google)March 26, 2026

Interactive, multimodal conversations in AI Mode are now available in over 200 countries & territories.

This update is powered by Gemini 3.1 Flash Live, our highest quality audio and voice model yet. This model is also inherently multilingual, so…pic.twitter.com/zRVV69hGUE

検索 Liveを日本でスタート

3.1 Flash Liveの登場にあわせて、「検索 Live」のグローバル展開を開始する。200以上の国と地域で、好みの言語で検索とリアルタイムのマルチモーダルな会話ができるようになる。日本でもスタートした。

検索 Liveは、音声とカメラの両方を使ってGoogle 検索の「AI モード」とインタラクティブな会話ができる機能。

検索 Liveの利用は、Google アプリで、検索バーの下にある [ ライブ ] アイコンをタップ。質問を声に出すと、音声回答で回答を得られ、そのまま追加の質問をして会話を続けたり、関連するウェブリンクで詳細を確認したりできる。

目の前にあるものについて質問する場合、例えば観葉植物の葉が黄色くなった原因を知りたいのであれば、カメラを有効にし、視覚情報を追加できる。これにより、検索はカメラに映っている状況を認識し、Web上のより詳しい情報へのリンクを提案する。

また、Google レンズでカメラをかざした状態からでも、 検索 Liveを利用できるほか、[ 文字起こし ] ボタンをタップしてテキスト形式の回答を確認したり、文字を入力して質問を続けるといった使い方も可能。

なお、3.1 Flash Liveによって生成される音声には、SynthIDの透かしが入っている。透かしは音声出力に直接織り込まれ、AI生成コンテンツを確実に検知することで、誤情報の拡散を防止する。