ニュース

NTT、LLM間の"語彙の壁"克服 異種LLMを連携可能に

2026年4月22日 17:08

NTTは、大規模言語モデル(LLM)における入出力単位「トークン」の語彙を精度劣化なく縮小させ、異なるLLM間でもトークン語彙を共通化できる世界初の推論技術を確立した。

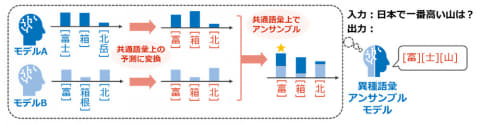

LLMは文章を「トークン」という単位で処理し、次に出力するトークンを確率的に予測しながら推論を進める。ただし、LLMごとに使うトークン語彙は異なるのが一般的。この違いにより、モデル同士で推論中の予測結果を直接比較・共有できない「語彙の壁」が生じている。その結果、複数モデルの予測を組み合わせるアンサンブルや、別モデルへ知識を移すポータブルチューニングなど、異なるLLM間のトークンレベル連携が難しい状況だった。

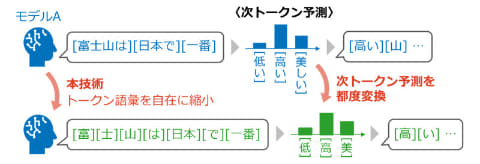

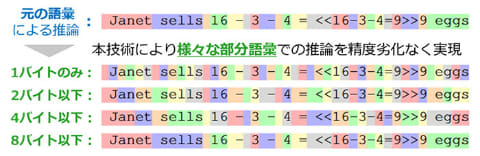

今回の研究では、LLMが用いるトークン語彙を、精度を落とさず柔軟に縮小できる世界初の技術を確立。推論中の次トークン予測を、指定した一部のトークンだけを候補とする形に変換できる。

独自の理論に基づく変換アルゴリズムにより、文章全体の傾向を保ったまま、任意の部分語彙で推論できるのが特長。これにより、語彙の異なるLLM同士でも「最大共通語彙」を介した推論時連携が可能で、アンサンブルによる知識統合やポータブルチューニングによる知識転移を実現できる。

実験では、異なる語彙を持つLLM同士でも性能を維持したまま共通トークンで連携でき、さらに推論精度の向上も確認している。