ニュース

グーグル、埋め込みモデル「Gemini Embedding 2」 マルチモーダル対応

2026年3月11日 12:51

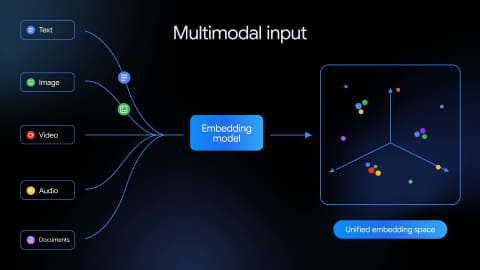

Googleは10日(米国時間)、マルチモーダル対応の埋め込みモデル「Gemini Embedding 2」を発表し、Gemini APIおよびVertex AIを通じてパブリックプレビューで提供開始した。テキスト、画像、動画、音声、ドキュメントを単一の埋め込み空間にマッピングし、異なる種類のメディアを横断した検索や分類に対応する。

Gemini Embedding 2は、Geminiアーキテクチャをベースにした同社初のネイティブなマルチモーダル埋め込みモデル。100以上の言語にわたってデータの意味内容を捉えられるとしており、Retrieval-Augmented Generation(RAG)やセマンティック検索、感情分析、データクラスタリングなどの処理能力向上につなげる。

入力仕様として、テキストは最大8,192トークン、画像はPNG/JPEG形式で1リクエストあたり最大6枚、動画はMP4/MOV形式で最大120秒、音声は途中で文字起こしを介さずに直接埋め込みできる。ドキュメントは最大6ページのPDFを直接埋め込める。

画像とテキストのように複数のモダリティを1つのリクエストでまとめて入力でき、異なる種類のデータ間の関係も捉えられる。また、埋め込みの出力はデフォルトの3,072次元から1,536次元や768次元などへ柔軟に縮小可能なMatryoshka Representation Learning(MRL)も採用した。

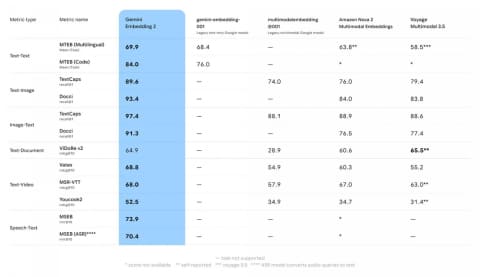

GoogleはGemini Embedding 2について、従来モデルの改良にとどまらず、マルチモーダル領域で新たな性能水準を打ち立てるモデルと位置付ける。強力な音声認識機能を備えるほか、テキスト、画像、動画の各タスクで高い性能を発揮し、多様な埋め込みニーズに対応できるとしている。

利用はGemini APIまたはVertex AIから開始できる。Gemini APIとVertex AI向けの対話型Colabノートブックも公開しているほか、LangChain、LlamaIndex、Haystack、Weaviate、QDrant、ChromaDB、Vector Searchからも利用できる。