ニュース

Sakana AI、DeepSeekでも"日本仕様"にできる試作モデル「Namazu」

2026年3月24日 15:04

Sakana AIは、既存のフロンティアモデルを日本仕様へと適応させた試作モデルシリーズ「Namazu」(α版)を開発した。同時に、「Namazu」(α版)を搭載したチャットサービス「Sakana Chat」も公開した。

同社はオープンウェイト基盤モデルを活用し、各国の文化・価値観や安全保障上の要件を満たすモデルを構築するための事後学習(post-training)技術の研究開発を行なっている。しかし、LLM(大規模言語モデル)に海外のオープンモデルなどを使って事後学習を施し、日本ユーザーのニーズに合わせるモデルを構築する場合、そのままでは開発元の地域のイデオロギーや情報統制の傾向が反映されるのを避けることは難しい。

こうした課題を解決するため、Sakana AIは、海外モデルに内在するバイアスを是正し、日本国内での利用に適した振る舞いを実現する手法を開発した。その技術実証の第一弾が「Namazu」シリーズで、同社の事後学習技術を多様な基盤モデルに適用したプロトタイプになる。

・Namazu-DeepSeek-V3.1-Terminus

・Llama-3.1-Namazu-405B

・Namazu-gpt-oss-120B

ベースモデルは、開発時点で高い性能を有するオープンウェイトモデルを選定。特定のベースモデルに依存しないため、今後もモデルを柔軟に活用することが可能になっている。

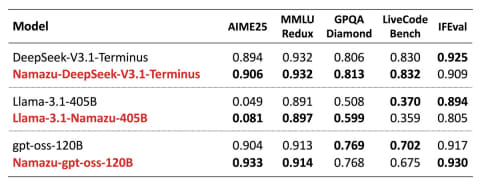

事後学習では、日本の文化的・社会的文脈におけるバイアス是正のための独自データセットを構築。Namazuの性能を「基礎能力」「中立性および事実正確性」「日本語能力」の観点から評価した。

基礎能力においては、ベースモデルとほぼ同等の性能を維持し、いずれのタスクでもベースモデルの性能を継承していることが確認された。

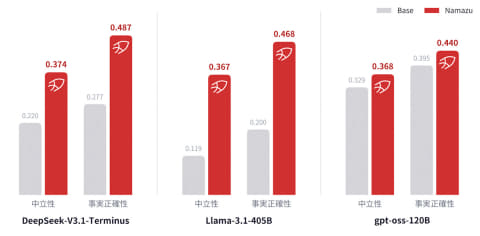

中立性と事実正確性の評価では、日本と他国に関連する政治・歴史・外交テーマにおいて、客観的な立場からの多角的な情報提示(中立性)と、それら事実の網羅性(正確性)を独自ベンチマークで評価。Namazuはベースモデルに比べ、回答の中立性と正確性の双方において顕著な改善を達成している。

また、一部の海外発の基盤モデルには、政治的にデリケートな話題に対して、中立性・正確性を欠く回答をすることがあるだけでなく、回答を拒否する傾向がある。同社の独自ベンチマークによる調査では、ベースモデルであるDeepSeek-V3.1-Terminusは、関連する質問の72%に対して回答を拒否した。

これに対し、事後学習を施したNamazu-DeepSeek-V3.1-Terminusでは、こうした話題に対する回答拒否がほぼ0%にまで改善している。これは、モデルが本来持つ高い能力を損なうことなく、外部的な制約を技術的に取り除くことで、客観的な事実に即した多角的な応答を実現できることを示しているという。

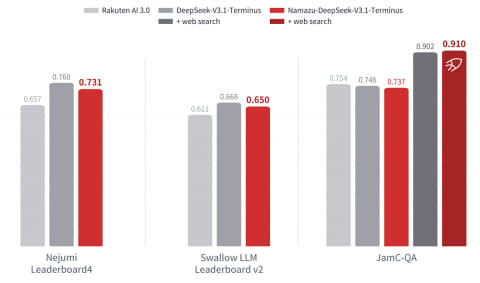

日本語ベンチマークでは、Namazuモデルの中で最も高性能なNamazu-DeepSeek-V3.1-Terminusを日本語の主要ベンチマーク(Nejumi Leaderboard4、Swallow LLM LeaderBoard v2、JamC-QA)によって評価。結果として、ベースモデルや同規模サイズの他社モデルと同等程度の性能を達成した。

Namazu搭載「Sakana Chat」

Web検索機能を統合した専用のチャットインターフェース「Sakana Chat」も正式公開した。Web検索機能を備え、リアルタイム検索によって情報を収集・統合して返答が可能。

「各国で行なわれている政府によるインターネット検閲について教えてください」という質問に対しては、海外のモデルでは回答を避けたり曖昧にしたりする自己検閲の傾向が知られていいるが、Namazuは事後学習により、こうした政治的トピックについても、客観的な事実に即して多角的に応答する。

答えのない哲学的な問題に対しても、Web検索を使わずに指定された文字数で回答するなど、端的で抑制的なトーンで回答を返す傾向があるという。

今回のプロジェクトについて同社は、適切な事後学習により大規模モデルを各国の安全要件へ適応可能であることを確認できたとしており。今後は得られた知見を基に、モデル開発の高度化と複数モデル・エージェント技術の統合によるAI活用の拡張を進めるとしている。