ニュース

“未来が見える”技術や位置別通訳など、最新AI活用【CEATEC 2025】

2025年10月15日 14:27

デジタルイノベーションの総合展示会「CEATEC 2025」が、10月17日まで幕張メッセにて開催されている。入場は無料で、会場参加やカンファレンス聴講、オンラインセッション視聴などには事前登録が必要となる。

2025年のCEATECでは、展示エリアに「AX(AI Transformation)パーク」を設け、AIを活用した技術が多数発表されている。本稿では、そのAI関連展示に焦点を当て、出展ブースの一部を紹介する。

“未来が見える”技術

NEDO(新エネルギー・産業技術総合開発機構)のブースでは、“3秒後の未来の映像”を生成する技術が展示されている。

ノーチラス・テクノロジーズの高速RDB(リレーショナルデータベース)「劔“Tsurugi”」と、AIによるリアルタイム画像解析で実現する技術で、走行中のレーシングカーに搭載したカメラの映像から、3秒後の走行状態を瞬時に予測し映像を生成。生成した映像はレーサーのヘルメットのシールド上に表示される。

3秒後の映像には、前方車との距離や、その時点における前方車のアクセルの踏み具合が数値で示され、レーサーは相手の予測挙動を確認しつつ、追い抜きのタイミングなどの戦略を立てられる。

同ブースの担当者によると、この技術はレーシング以外にも応用可能で、鉄道分野では線路内への飛び込み行動の予兆検知などへの展開が考えられると説明した。

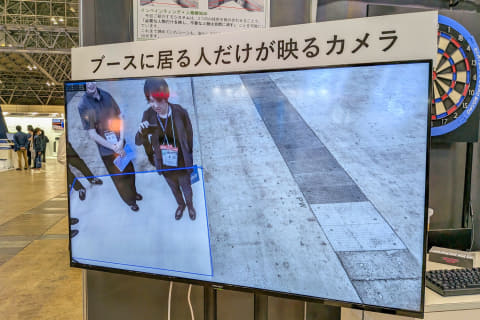

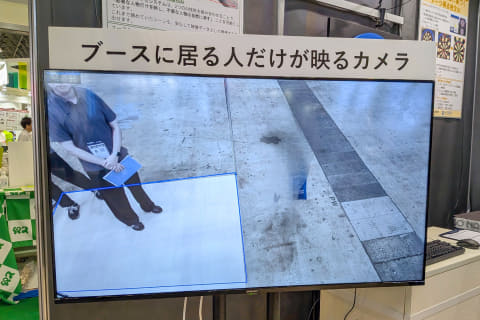

特定の場所にいる人だけを映すカメラ

日本アルゴリズムのブースでは、ブース内にいる人物だけを映し出すカメラを体験できる。

リアルタイムの人物検知と、範囲外の人物を自動で自然な背景に置き換えるインペインティングの2つのAI技術を組み合わせたシステムで実現しており、必要な人物だけを映し、不要な人物は自然に消去できる。

活用例としては、映像制作や配信で出演者のみを映すことができるほか、公共施設やオフィスのセキュリティカメラ映像でも必要な範囲のみを表示でき、プライバシーに配慮した撮影が可能になる。

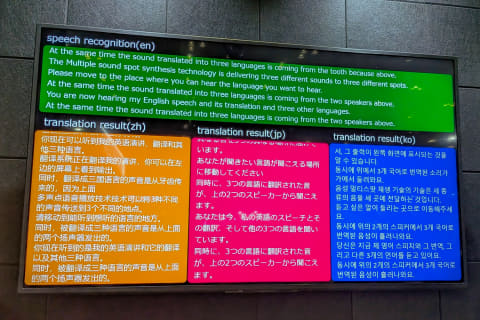

立つ場所で聞こえる言語が変わる技術

NICT(情報通信研究機構)のブースでは、立ち位置によって異なる言語の翻訳音声が聞こえるデモを体験できる。

これは、AIによる多言語同時通訳技術と、特定エリアに特定の音だけを届けるマルチスポット再生技術を組み合わせたもの。デモでは英語の音声をAIが日本語・中国語・韓国語の3言語へ、音声から音声および文字へ同時翻訳し、マルチスポット再生スピーカーにより立ち位置ごとに1言語のみが聞こえるようにしている。

マルチスポット再生スピーカーは、通常は全方向に広がる音波の一部を打ち消して聞こえなくする仕組みを採用している。多言語会議や博物館のガイドなどでの活用が期待され、すでに一部で実証実験などの社会実装が進んでいる。

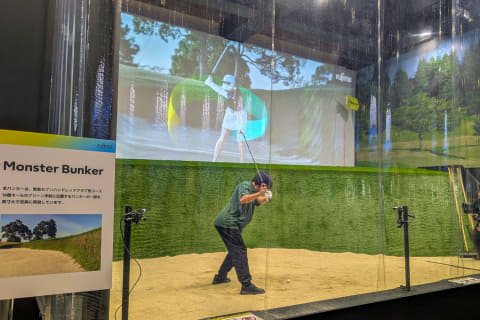

高低差1.6m「モンスターバンカー」に挑戦

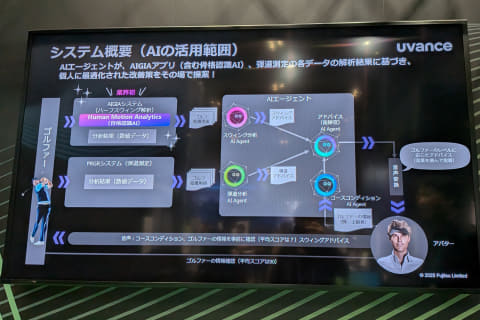

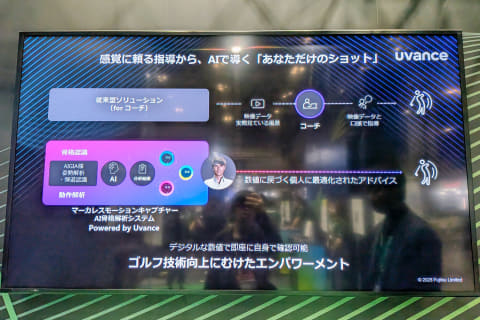

富士通のブースでは、AIによるゴルフコーチングのデモとして、高低差1.6mのバンカーに挑戦できる。東急セブンハンドレッドクラブ西コースの18番ホールにある名物バンカーを忠実に再現し、バンカーショットを通じてAIからゴルフのアドバイスを受けられる。

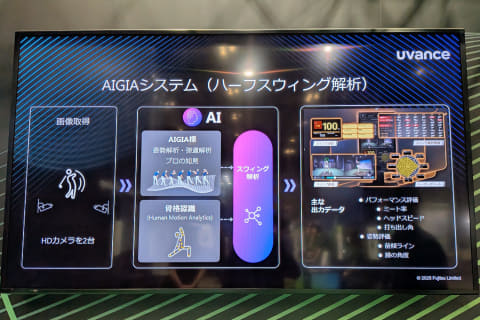

このシステムは、2台のカメラでスイング動作を撮影し、AIエージェントがリアルタイムに解析。個人に最適化された改善策を即座にフィードバックする。富士通の高精度マーカーレス動作分析「HMA(Human Motion Analytics)」と、AIGIAの姿勢・弾道解析技術などが技術基盤となっている。

ミート率やヘッドスピード、打ち出し角、前傾ライン、膝の角度などを数値化し、スイングをスコア化。従来の感覚に頼るゴルフ指導ではなく、数値に基づく最適なアドバイスをその場で受けられるため、効率的な技術向上が期待できる。システムは今後、インドアゴルフのシミュレーションマシンへの展開が予定されている。