ニュース

AWS、初の3nm AIチップ搭載「Trainium3」 最大4.4倍高速化

2025年12月3日 14:35

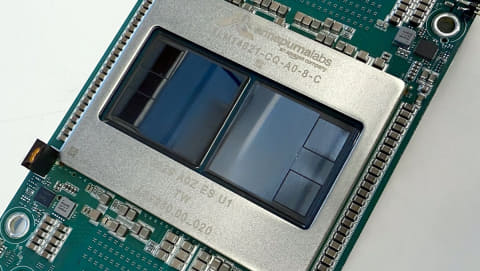

Amazon Web Services(AWS)は、初の3nm AIチップ「Trainium3」を搭載する「Trainium3 UltraServer」の提供を開始した。

Trainium3 UltraServerは、最大144個のTrainium3チップを単一の統合システムに搭載。Trainium2 UltraServerと比較して最大4.4倍の性能を誇る。これによってモデルのトレーニングが高速化され、数カ月かかっていたトレーニング時間を数週間に短縮が可能。

OpenAIのGPT-OSSを使ったテストでは、Trainium2 UltraServerと比較してチップあたりのスループットは3倍向上。応答時間は4倍高速化されている。

Trainium3は大幅な省電力化も実現しており、前世代と比較してエネルギー効率が4倍向上。データセンター全体の環境負荷を軽減しながら、より費用対効果の高いAIインフラを提供する。

Trainium3 UltraServerを垂直統合するためのシステムとして、分散型AIコンピューティングの制約となる通信ボトルネックを解消するために設計されたネットワークインフラストラクチャ「NeuronSwitch-v1」も開発。各UltraServer内で2倍の帯域幅を提供し、チップ間の通信遅延を10マイクロ秒未満に短縮している。

AWSでは現在、Trainium4の開発に着手しており、Trainium3と比較してAIモデルのトレーニング速度は3倍以上、推論リクエストの実行回数も3倍以上を目指すとしている。